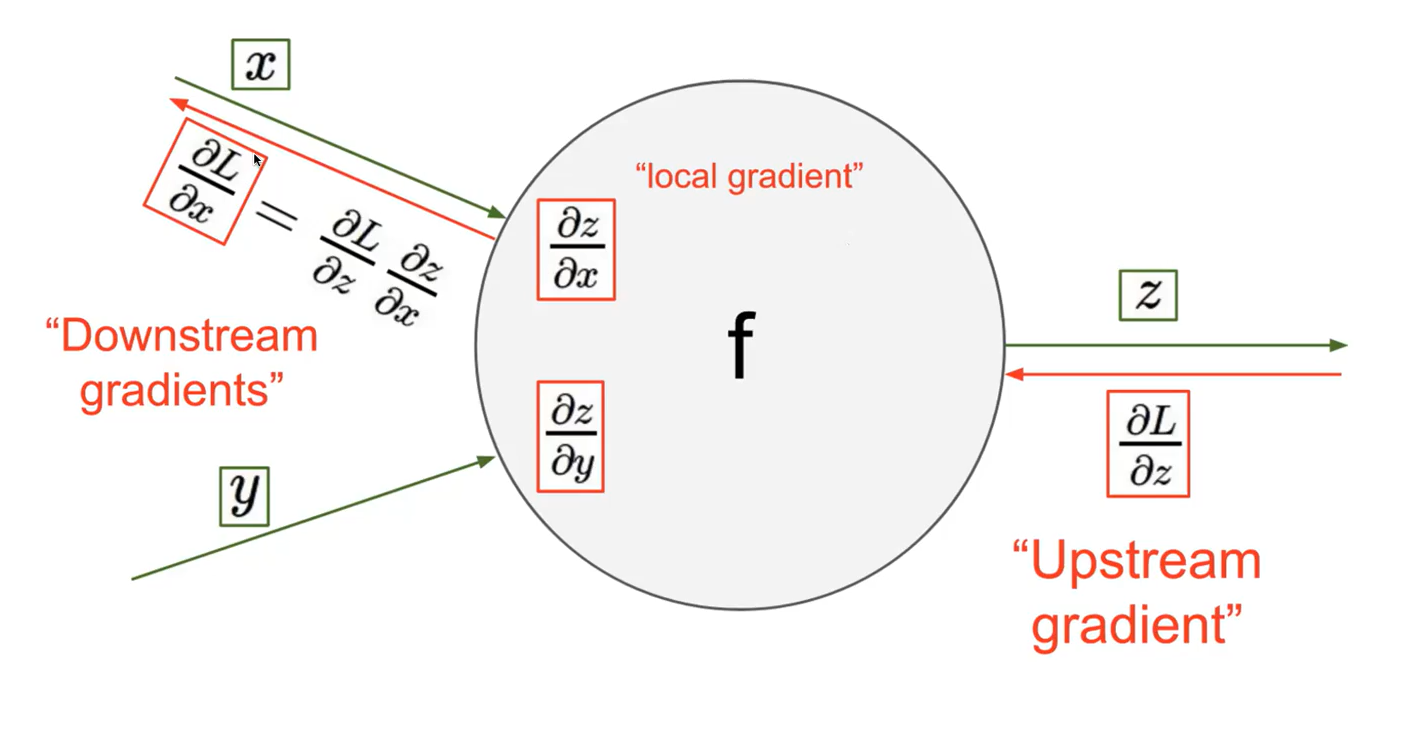

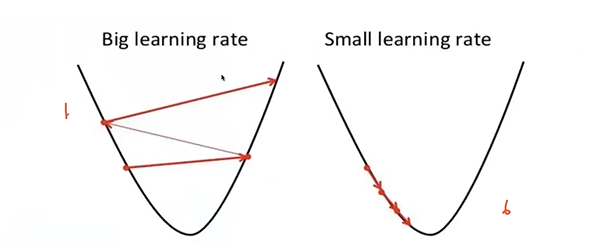

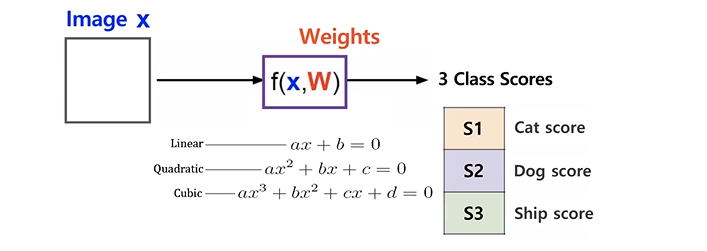

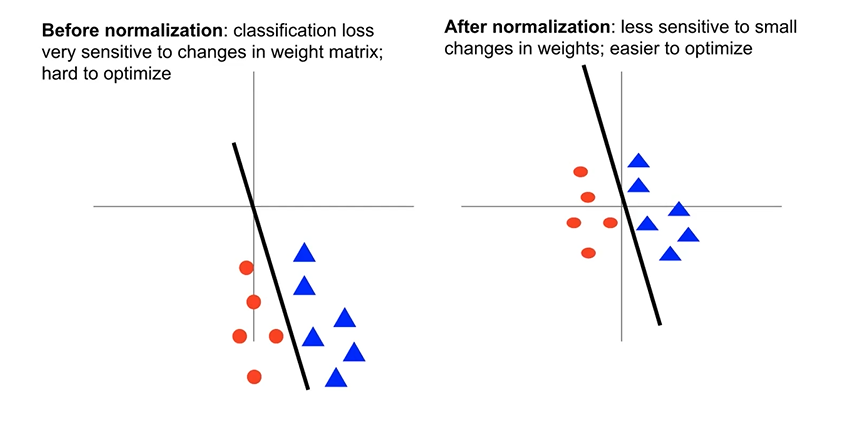

Computational Graph Gradient loss function은 결국 W에 대한 함수이기 때문에, 특정 W에서의 편미분을 통해 gradient(기울기)가 낮은 방향으로 가면, loss를 줄일 수 있다. 결국 gradient는 편미분들로 구성되어있는 일종의 vector라고 볼 수 있다. 각 weight에 대해서 편미분되므로 여러개의 가중치가 있을 때에는 하나의 편미분 값이 아닌, vector로 표현될 수 있다. Backpropagation How to compute gradients? : layer가 20개 이상으로 너무 deep하거나 너무 복잡하면, loss funciton이 너무 복잡해져, 이것을 편미분하는 계산 과정이 너무너무너무울트라슈퍼똥방구 복잡해진다.... 위 식처럼 이미 loss..